-

Prior construction 3 - feat. 하늘에 별 따기NeurIPS_26 2026. 3. 29. 21:42

prior construction 2에서 언급했듯이,

MIMIC downstream task에서 evaluate하였을 때 좋은 성능을 보여주는 foundation model을 만들기 위한 pretraining dataset을 구현하는 것은 쉽지 않다.

GPT와 머리를 맞대고 만들기는 하였는데,

말은 되지만,

과연 이걸로 training을 하였을 때, 성공할 것인가? 는 희박해 보인다.

어떻게 만들었냐하면,

3 dim treatment, 2 dim outcome, 1 static feature, 25 covariates 동일한 config를 구성하고

서로 간의 random한 causal structure를 구성하였다.

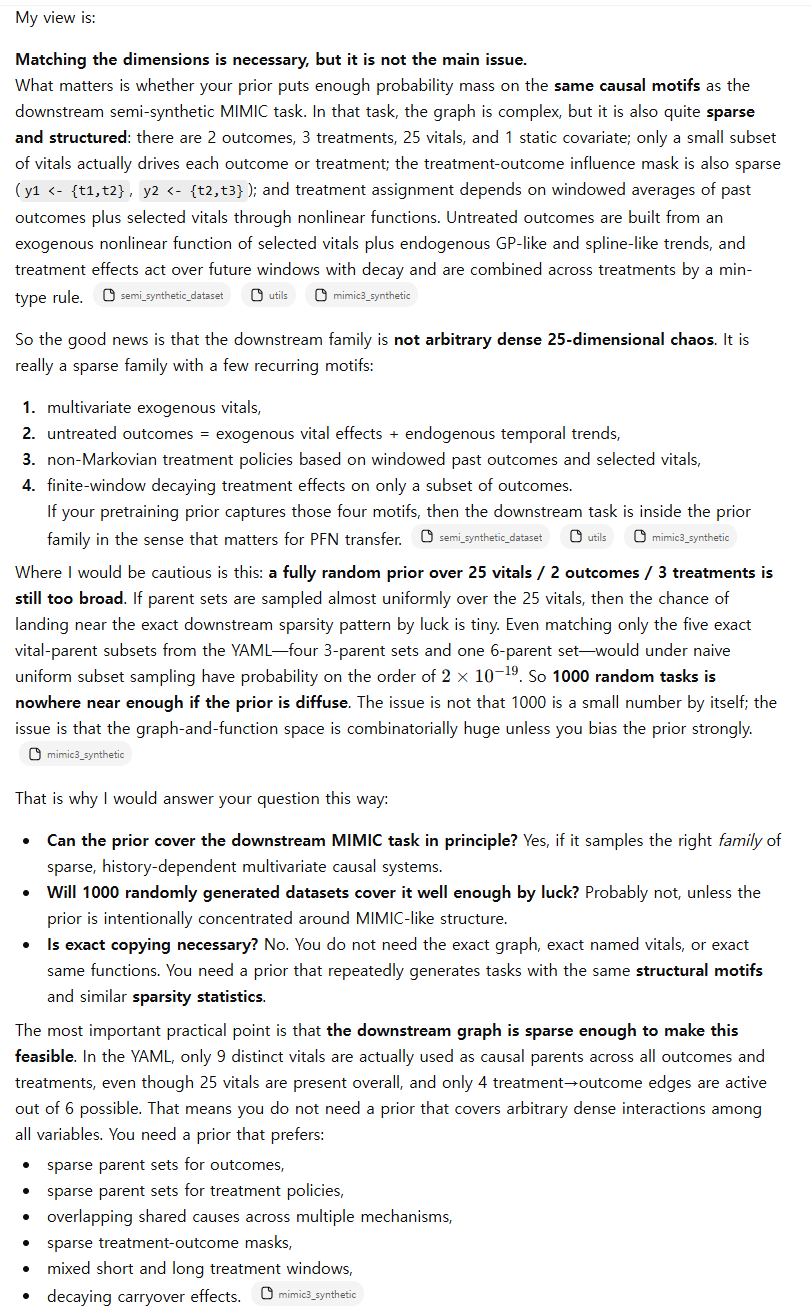

그렇다면.. 이는 combinatorially huge space이다!!

prior가 cover하는 건 맞지만, 너무 broad하다.

앞선 글에 dag structure를 그렸지만, 그 specific case를 sampling하기는 거의..

하늘의 별 따기 수준이랄까?

그래서.. GPT와 토론하였다.

역시 GPT도 나와 비슷한 생각이다.

수정이 필요하다. 흠..

과연 해결책이 나올까요..?

그래 내가 하고 싶은 말이 이거였어.

내 맘 알아줘서 고마워.

"broad enough to be a foundation prior, yet biased enough that MIMIC-like sparse multivariate non-Markovian tasks appea often"

그니까..foundation model이긴 하지만서도, downstream task에서 성능이 잘 나올 만큼의 bias가 필요하단 말이징.

'NeurIPS_26' 카테고리의 다른 글

Prior construction 5 - mechanism (cancer) (0) 2026.03.30 Prior construction 4 - mechanism (mimic) (0) 2026.03.30 Prior construction 2 (0) 2026.03.29 Prior construction (0) 2026.03.28 Agentic World 2. (0) 2026.03.26